O Instagram e o Facebook são duas das maiores redes sociais do momento. E junto com essa popularidade, há uma série de empresas que apostam na propaganda para promoverem seus produtos. Inclusive algumas que sequer deveriam estar por lá, como é o caso de aplicativos que prometem “apagar” a roupa de mulheres em fotos postadas.

Além de serem contra a política de ambas as redes sociais, que proíbe qualquer veiculação de imagens com nudez, os apps promovem uma propaganda enganosa. Isso porque esses mesmos softwares promovidos são utilizados para criar, via Chat GPT, uma espécie de “namorada virtual” que reproduz diálogos pornográficos com os usuários.

Anúncios de app para criação de nudes fakes eram promovidos no Instagram e no Facebook. (Imagem: NY Post/Divulgação)Fonte: NY Post

Anúncios de app para criação de nudes fakes eram promovidos no Instagram e no Facebook. (Imagem: NY Post/Divulgação)Fonte: NY Post

Apps também criam imagens pornográficas com IA

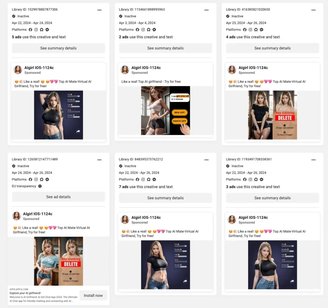

Se não bastasse tamanha polêmica, esses mesmos apps também criam imagens pornográficas, de modelos virtuais, geradas através da Inteligência Artificial. Isso também viola outra diretriz das políticas de uso das redes sociais da Meta, que proíbe comercialização de conteúdo pornográfico, ou até mesmo a exploração sexual.

Sites como o Wired e o NY Post publicaram matérias sobre o tema, e alegaram terem encontrado mais de 2.700 anúncios dias antes das reportagens irem ao ar. Já a Meta, por sua vez, alegou que mantém um trabalho constante para a proibição e remoção de anúncios que vão contra suas políticas de uso.

Apps anunciados criavam chats virtuais com conteúdo pornográfico. (NY Post/Divulgação)Fonte: NY Post

Apps anunciados criavam chats virtuais com conteúdo pornográfico. (NY Post/Divulgação)Fonte: NY Post

Apple Store remove apps com essa finalidade

Curiosamente, na semana passada, a Apple Store removeu uma série de aplicativos que propagavam essa prática ilegal, o chamado deep nude. Eles “removiam” roupas de mulheres em imagens, sobrepondo com partes nuas do corpo de outras pessoas, através de Inteligência Artificial, criando nudes fakes. .

Esses aplicativos cobravam créditos virtuais, que eram adquiridos através de dinheiro real, para que fossem feitas ações, como a remoção de determinadas peças de roupa, ou de todas elas. Aqui no Brasil, até mesmo algumas celebridades, como a atriz Isis Valverde e a cantora Luiza Sonza, foram vítimas de manipulação de suas fotos. Vale ressaltar que a prática é um crime e pode levar até mesmo à cadeia.

App Store removeu aplicativos que geravam nudes fake. (Reprodução/TecMundo)Fonte: Reprodução / TecMundo

App Store removeu aplicativos que geravam nudes fake. (Reprodução/TecMundo)Fonte: Reprodução / TecMundo

Outro lado

Em nota enviada ao site g1, a Meta, holding dona de Facebook e Instagram, diz que removeu os anúncios que violavam as políticas de uso. Além disso, a companhia informou que está aprimorando a detecção de conteúdos ilegais nas plataformas. Confira, abaixo, a íntegra da nota da empresa:

“Removemos os anúncios apontados pela reportagem por violar nossas políticas. Revisamos conteúdo por meio da combinação de tecnologia de Inteligência Artificial e equipes humanas, que nos ajudam a detectar, analisar e remover conteúdos que violem os Padrões da Comunidade do Facebook, as Diretrizes da Comunidade do Instagram e os nossos Padrões de Publicidade. Estamos sempre aprimorando nossos esforços para manter nossas plataformas seguras e também incentivamos as pessoas a denunciarem conteúdos e contas que acreditem violar nossas políticas através das ferramentas disponíveis dentro dos próprios aplicativos”.

#SuperCurioso | www.supercurioso.online